AI Google перестанет использовать гендерные теги

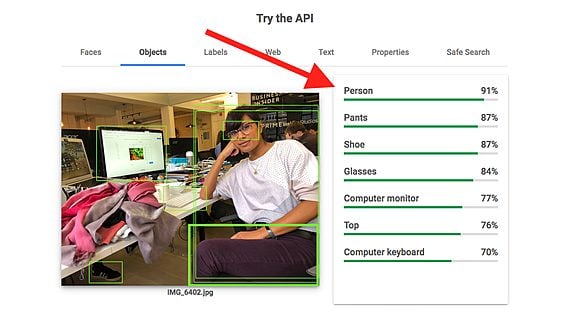

Google Cloud Vision API для распознавания и маркирования объектов больше не будет применять к людям на изображениях теги «мужчина» и «женщина», пишет Business Insider.

Google Cloud Vision API для распознавания и маркирования объектов больше не будет применять к людям на изображениях теги «мужчина» и «женщина», пишет Business Insider.

Google Cloud Vision API для распознавания и маркирования объектов больше не будет применять к людям на изображениях теги «мужчина» и «женщина», пишет Business Insider.

Инструмент умеет распознавать лица, геолокации, логотипы и массу другого контента и имеет широкий круг пользователей от ритейлеров до учёных. Теперь людей на фотографиях он будет обозначать нейтральным словом «person».

Google аргументирует свой шаг этическими соображениями. Во-первых, не всегда возможно определить гендер человека только по его внешности. Во-вторых, такое деление может привести к предвзятости и несправедливой дискриминации.

Некоторые называют такое решение Google «очень позитивным». Например, эксперты по проблеме предвзятости AI в Mozilla говорят, что при автоматической классификации людей, будь то по гендеру или ориентации, для начала нужно обозначить категории, по которым их будут разносить — уже на этом этапе заложено множество допущений. Разделение на мужчин и женщин предполагает, что гендер — бинарное понятие, а все те, кто не вписывается в такую систему, будут автоматически классифицированы неверно. Тем более, о гендере невозможно судить исключительно по внешности, и любая AI-система, которая это делает, неизбежно совершает ошибки, считают в Mozilla.

Разработчикам, которых коснётся изменение Cloud Vision API, Google предлагает обсудить его на своих форумах.

Релоцировались? Теперь вы можете комментировать без верификации аккаунта.